| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

- VirtualTryON

- image editing

- 3d editing

- flow matching models

- rectified flow models

- flow matching

- 네이버 부스트캠프 ai tech 6기

- diffusion models

- video generation

- inversion

- 코테

- rectified flow

- 3d generation

- 논문리뷰

- memorization

- Machine Unlearning

- Concept Erasure

- 프로그래머스

- ddim inversion

- rectified flow matching models

- image generation

- diffusion

- unlearning

- Programmers

- video editing

- flow models

- Python

- BOJ

- diffusion model

- visiontransformer

- Today

- Total

평범한 필기장

[평범한 학부생이 하는 논문 리뷰] Classifier-Free Guidance inside the Attraction Basin May Cause Memorization (CVPR 2025) 본문

[평범한 학부생이 하는 논문 리뷰] Classifier-Free Guidance inside the Attraction Basin May Cause Memorization (CVPR 2025)

junseok-rh 2025. 3. 13. 23:39Paper : https://arxiv.org/abs/2411.16738

Classifier-Free Guidance inside the Attraction Basin May Cause Memorization

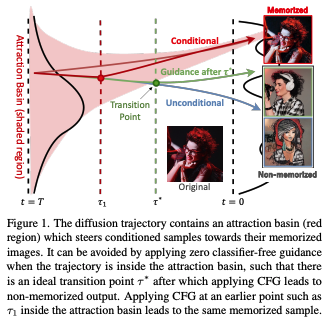

Diffusion models are prone to exactly reproduce images from the training data. This exact reproduction of the training data is concerning as it can lead to copyright infringement and/or leakage of privacy-sensitive information. In this paper, we present a

arxiv.org

Abstract

해결하려는 문제

Diffusion model은 training data로부터의 image들을 reproduce하기 쉬움 (memorization)

본 논문의 주장

Memorization은 diffusion trajectory를 memorized image를 향하도록 조종하는 denoising process에서의 attraction basin때문에 발생

Memorization Mitigation

이상적인 transition point까지 CFG를 적용하지 않음으로써 attraction basin으로부터 멀리 떨어진 diffusion trajectory를 가이드함. 거기에 더해 opposite guidance를 제안해 denoising process에서 더 이르게 attraction basin을 탈출.

1. Introduction

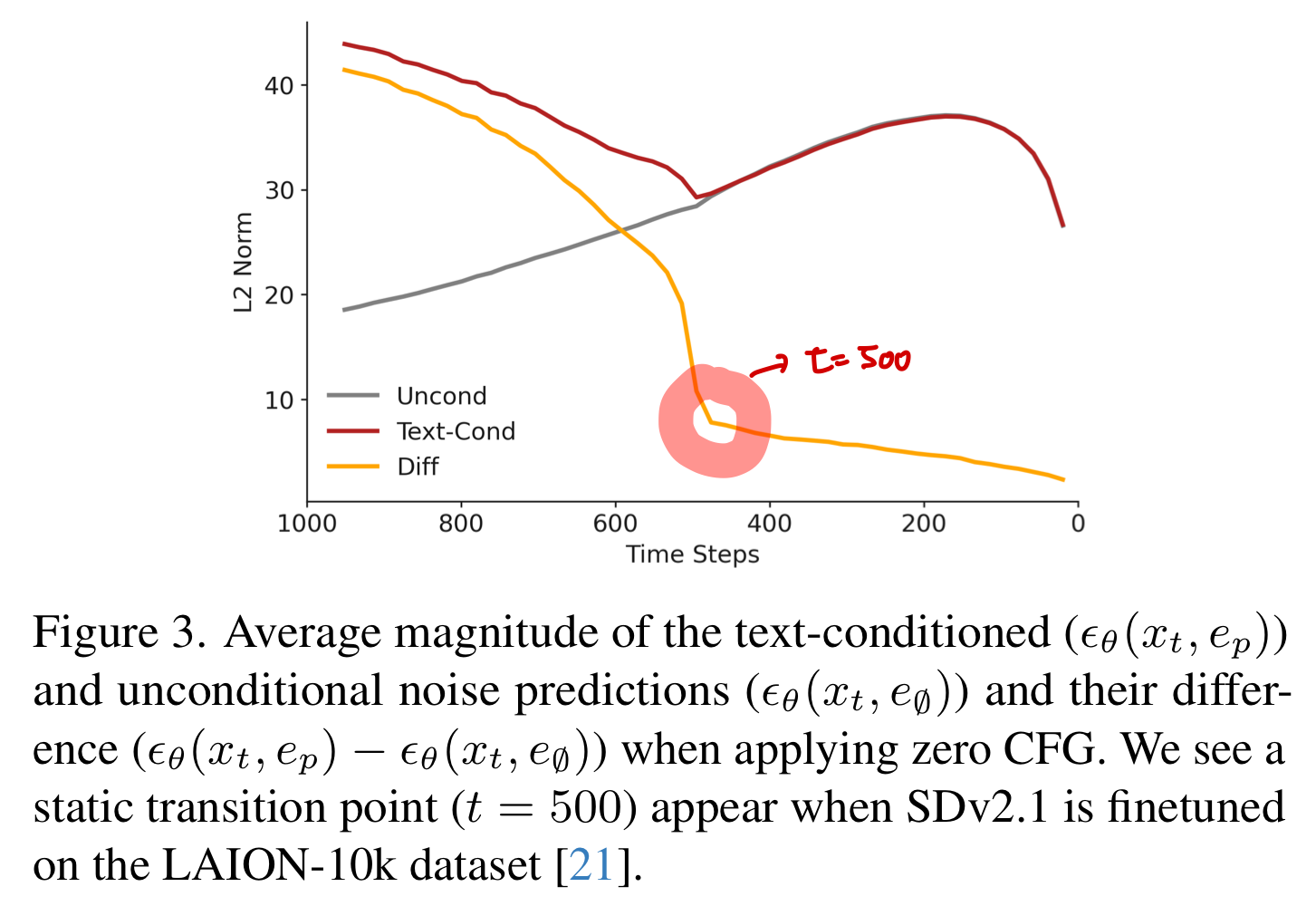

Memorization이 발생할 때, text-conditioned noise prediction이 독특하게 높다. 이는 memorized output을 향하는 강한 steering force가 있다는 것을 제안한다 (심지어 다른 initialization에서도 동일한 output). 본 논문은 attraction basin이 CFG를 적용할 때 random initialization에서 memorized trajectory를 향하도록 denoising process를 지시하는 이런 diffusion trajectory 주변에 형성되는 것을 보인다. Attraction basin은 특정 방향으로 trajectory를 강제하는 매우 높은 text-conditioned noise prediction score를 가지는 diffusion trajectory안의 구역으로 생각될 수 있다. Attraction basin은 denoising time step이 지날수록 더 좁아진다. 몇번의 step 이후로, 강한 steering force는 모든 곳에 존재하지 않고, trajectory가 attraction basin안에 있을 때만 경험될 수 있다. 초기에 transition point까지 guidance를 적용하지 않고 그 후로 CFG를 적용함으로써 non-memorized image를 생성할 수 있다.

본 논문의 contribution은 다음과 같다.

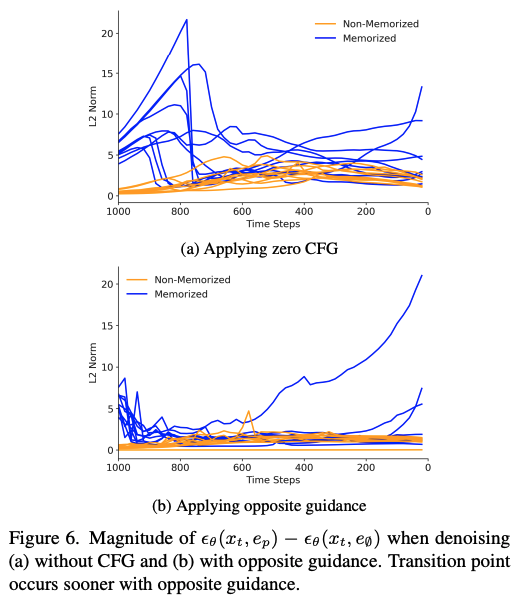

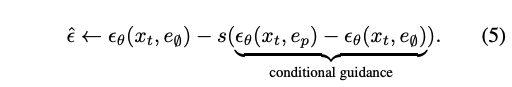

2. Understanding Diffusion Trajectory during Memorization

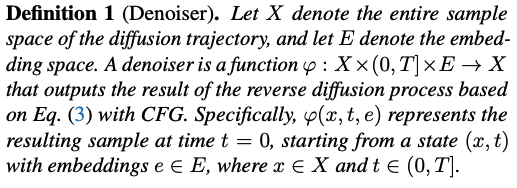

Memorization이 발생할 경우, $x_t$로부터 $x_{t-1}$를 예측할 때 사용되는 conditional guidance $\epsilon_\theta(x_t,e_p) - \epsilon_\theta(x_t,\epsilon_\varnothing)$가 특이하게 높게 나타난다 (→ 특정한 sample로 diffusion trajectory를 향하게 하는 strong force가 존재). Attraction basin이 있고, 어떠한 timestep $t$에서 latent $x_t$가 이 구역에 빠지면, CFG를 적용하는 것이 memorized output으로 이끈다. 그러나, $x_t$가 attraction basin에 있지 않으면, 어떠한 guidance weight를 가진 CFG를 적용하더라도 memorized output이 발생하지 않는다. Attraction basin을 정의하기 위해서 denoiser의 개념을 도입한다.

Training dataset으로부터 attractor $x^a$에 대해서 다음처럼 attraction basin을 정의한다.

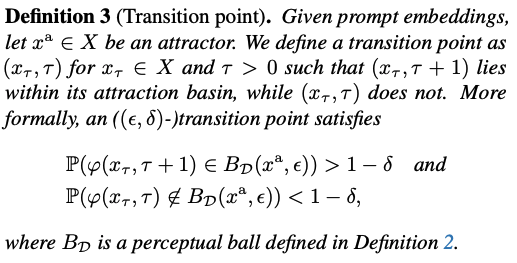

Conditional noise prediction $\epsilon_\theta(x_t, e_p) - \epsilon_\theta(x_t,e_\varnothing)$이 초기 time step에서 높게 나타나고 급격히 떨어진다. 본 논문에서는 이렇게 높은 conditional noise prediction을 attraction basin이라고 부른다. Denoising trajectory가 attraction basin을 떠나는 time step을 memorized output에서 non-memorized output으로의 transition point라고 부른다. Transition point를 다음과 같이 정의한다.

이 현상은 오직 memorized sample에 대해서만 발생한다. Non-memorized sample에 대해서는 conditional guidance $\epsilon_\theta(x_t, e_p) - \epsilon_\theta(x_t,e_\varnothing)$가 모든 time step에 따라 낮고 거의 평평하게 나타난다.

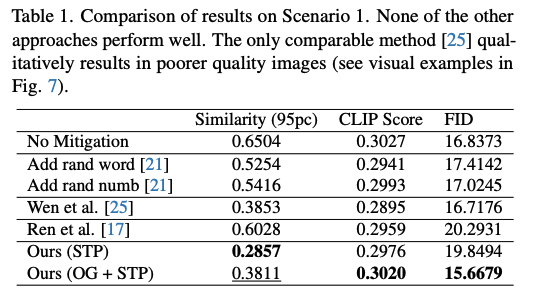

3. Simple Mitigation Strategy

이상적인 transition point를 찾아 zero CFG에서 CFG를 적용하는 것으로 바꿈으로 memorization을 완화할 수 있다.

Static Transition Point

위와 같이 transition point가 $t=500$으로 static한 경우가 있다.

Dynamic Transition Point

어떤 trained diffusion model에 대해서는, 모든 prompt와 initialization pair에 대해서 다른 transition point가 나타난다.

또한, figure 2에서 동일한 prompt에 대해서 다른 transition point가 발생하는 것 또한 볼 수 있다.

본 논문에서는 dynamic transition point를 찾는 방식을 제안한다. 이는 graph에서 첫 번째 local minima후의 point이다.

3.1 Opposite Guidance

위 방식에서 transition point가 너무 늦게 발생해서 CFG를 적용하는 time step이 적어 image quality를 떨어뜨리는 문제가 나타날 수 있다. 본 논문에서는 transition point가 이르게 나타나도록 하기 위해 opposite guidance(OF)를 도입한다. 이는 diffusion trajectory를 기존의 CFG의 반대 방향으로 강제해, denoising process에서 더 이르게 기존의 CFG trajectory의 attraction basin으로부터 멀리 떨어 뜨린다.

4. Memorization under Different Scenarios

4.1 Scenario 1

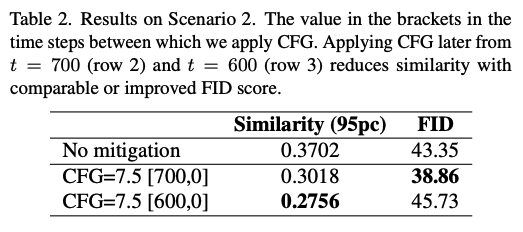

4.2 Scenario 2

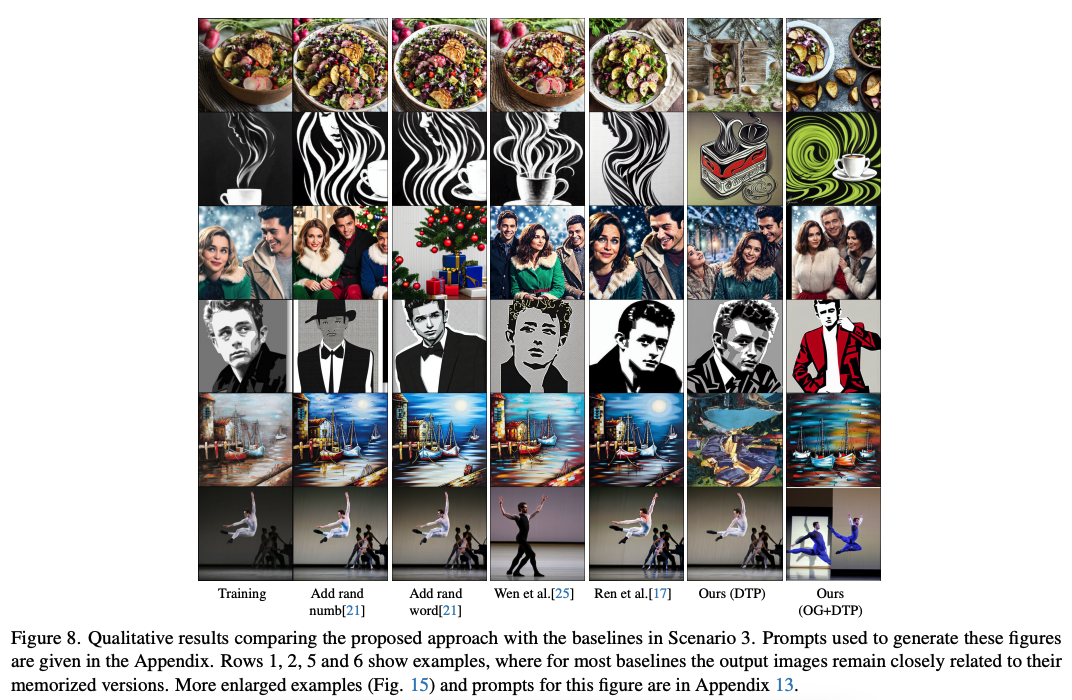

4.3 Scenario 3

Inference Time

본 논문의 major advantages는 간단함과 computational time overhead의 부족이다.

Limitations

Non-memorized sample에 대해서 transition point가 존재하지 않기 때문에, 본 논문의 approach를 적용하기 위해서 memorization을 detecting하는 것이 필요하다. Conditional guidance의 trend를 보고 mitigation을 하려면 denoising process를 두번 적용해야한다.