| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 네이버 부스트캠프 ai tech 6기

- flow matching

- image editing

- noise optimization

- diffusion model

- DP

- memorization

- video generation

- 프로그래머스

- BOJ

- 코딩테스트

- segmenation map generation

- 3d editing

- flipd

- visiontransformer

- rectified flow

- transformer

- VirtualTryON

- diffusion models

- 논문리뷰

- 3d generation

- 코테

- Python

- diffusion

- inversion

- segmentation map

- Programmers

- Vit

- masactrl

- video editing

- Today

- Total

목록논문리뷰 (6)

평범한 필기장

[평범한 학부생이 하는 논문 리뷰] VITON-HD: High-Resolution Virtual Try-On via Misalignment-Aware Normalization

[평범한 학부생이 하는 논문 리뷰] VITON-HD: High-Resolution Virtual Try-On via Misalignment-Aware Normalization

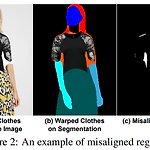

최근에 Virtual Try-On이라는 분야에 관심을 갖게되면서 두번 째로 읽게 된 논문이 바로 VITON-HD: High-Resolution Virtual Try-On via Misalignment-Aware Normalization이라는 논문이다. 이 논문을 선택한 이유 중 하나는 바로 저자분들이 한국분들이라는 것이다. 특히 주재걸 교수님이 저자에 있어서 더 눈에 띄었다. 0. 기존 Virtual Try-On의 한계Image-based Virtual Try-On은 주어진 인물사진에 대상 의상 아이템으로 변경한 이미지를 생성하는 모델이다. 기존 Virtual Try-On 모델들의 한계점은 바로 고해상도의 이미지를 만들 수 없다는 것이다. 해상도를 높일 수록 misaligned된 부분의 artifact..

[평범한 학부생이 하는 논문 리뷰] An Image-based Virtual Try-on (VITON)

[평범한 학부생이 하는 논문 리뷰] An Image-based Virtual Try-on (VITON)

평소에 패션에 관심이 많아서 패션과 관련 AI 분야를 찾다가 Virtual Try-on이라는 분야를 지인에게 듣게 되었다. 그래서 이번 방학 때 이 분야와 관련된 논문을 읽어봐야겠다고 결심하게 되었다.Virtual Try-on 관련된 논문들 중에서 첫 논문은 이 논문으로 정해서 이 논문을 처음으로 읽게 되었다. Abstract & Introduce많은 온라인 쇼핑몰에서 Virtual Try-on 기술을 이용하려한다. 대부분은 3D를 통해 기술을 구현하지만 많은 제약과 비싼 비용이 필요하다고 한다. 그런데 이 논문에서 제시한 VITION이라는 모델은 3D 정보를 이용하지 않고 RGB이미지에만 의존하는 모델이라고 설명한다. 그리고 이 모델에서 합성한 이미지는 (1) 인물의 신체 부위와 포즈가 원본 이미지와..

[평범한 학부생이 하는 논문 리뷰] Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Network (CycleGAN)

[평범한 학부생이 하는 논문 리뷰] Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Network (CycleGAN)

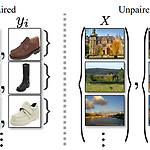

기존 image to image translation의 문제점 기존 pix2pix모델을 통한 image to image translation은 paired된 데이터로만 가능했다. 그러나 paired된 데이터는 실제로는 흔하지 않다. 그렇기에 unpaired된 데이터에 대해서도 image to image translation이 가능한 모델이 필요하다. 이러한 문제를 해결하기 위해 나온 모델이 바로 CycleGAN이다. CycleGAN은 그럼 어떤 차이점을 가졌길래 앞선 문제를 해결했을까? CycleGAN의 특징 위의 이미지(a)가 CycleGAN의 가장 특징을 보여준다. 기존의 GAN은 G:X→Y 라는 하나의 매핑함수만 가지고 이미지를 생성했다. 하지만 X라는 도메인에서 Y..

[평범한 학부생이 하는 논문 리뷰] StackGAN: Text to Photo-realistic Image Synthesis with Stacked Generative Adversarial Networks

[평범한 학부생이 하는 논문 리뷰] StackGAN: Text to Photo-realistic Image Synthesis with Stacked Generative Adversarial Networks

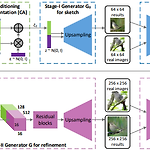

기존 Text to Image의 문제점 기존에 conditional GAN을 이용해서 Text to Image문제를 해결하려했지만 여러 문제점을 지녔다. text description의 의미를 rough하게 반영은 하지만 이미지의 detail이 떨어지고 생생한 object를 생성하지 못했다. 즉, 고화질의 사실적인 이미지를 생성하지 못했다. GAN에 upsampling layer를 더 쌓아서 해결하려했지만, instability를 보였고, nonsensical한 결과를 생성했다. 그래서 이러한 문제점들을 해결하려 했고, 그 결과로 StackGAN이라는 모델을 만들었다! Contribution StackGAN을 알아보기 전에 이 모델이 가지는 기여점에 대해 먼저 설명하겠다. Text로부터 photo-rea..

[평범한 학부생이 하는 논문 리뷰] Image-to-Image Translation with Conditional Adversarial Networks (Pix2Pix)

[평범한 학부생이 하는 논문 리뷰] Image-to-Image Translation with Conditional Adversarial Networks (Pix2Pix)

GAN, DCGAN을 읽고 나서 이번에는 Conditional GAN에 관한 논문을 읽어 봐야겠다라는 생각이 들기도 했고, 스터디에서도 이 논문을 읽을 차례가 돼서 이번엔 Image-to-Image Translation with Conditional Adversarial Networks를 정리할 겸 리뷰하려한다. 원본 논문 링크 : https://arxiv.org/abs/1611.07004 Image-to-Image Translation with Conditional Adversarial Networks We investigate conditional adversarial networks as a general-purpose solution to image-to-image translation probl..

[평범한 학부생이 하는 논문 리뷰] Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks

[평범한 학부생이 하는 논문 리뷰] Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks

기존 vanilla GAN이 가지는 한계점 학습이 불안정적이다. 불안정적으로 학습이 되다보니, Generator와 Discriminator사이의 힘의 균형이 깨져 한쪽이 계속 이겨버리는 상황이 발생한다. 그러다 보니 Generator가 종종 어처구니없는 이미지를 생성하게 된다. 결국 우리가 원하는 결과를 얻을 수 없게 된다. mode collapse GAN에서 Generator는 Discriminator를 속이는 방향으로 학습이 되는데 그러다 보니 데이터가 많은 이미지만 계속해서 생성하게 된다. 이렇게 되면 Discriminator를 속이는 것은 맞지만 다양한 이미지를 생성하는 것과는 맞지 않게 된다. Black-Box 방식 왜 이런 결과가 나왔는지 알 수 없다. 어떤 특징 때문에 이런 이미지가 생성됐는..